Meer vergevingsgezindheid leidt tot meer vertrouwen in AI

Om onderstaande en alle andere premium artikelen te lezen, moet u inloggen of een account aanmaken.

U kunt nog {free_articles_left} premium artikel gratis lezen. Om meer premium artikelen te lezen, moet u inloggen of een account aanmaken.

AI in de zorg. Voor de een is het een nachtmerriebeeld van kille algoritmes die het menselijk contact verdringen. Voor de ander een belofte van efficiëntere, vriendelijkere en zelfs betrouwbaardere zorg. Maar één vraag loopt als een rode draad door dit debat: vertrouwen we AI voldoende om de voordelen te kunnen benutten? Voor een heel belangrijk deel wordt dat vertrouwen beïnvloed door de fouten die een AI-toepassing maakt.

Uit onderzoek, ja al een tijdje geleden, in UMC Utrecht (NRC, 2019) blijkt dat we algoritmes systematisch strenger beoordelen dan menselijke experts (zie kader onderaan). Vertrouwen groeit echt niet door technische transparantie alleen – niemand verwacht dat een arts de werking van een MRI-scanner tot in de magnetische details kent of uitlegt aan elke patiënt. Vertrouwen groeit door ervaring, door herhaald bewijs dat de uitkomsten betrouwbaar zijn in de context waarin ze worden gebruikt maar vooral wat voor emotie en gevoel we hebben bij de fouten die worden gemaakt. En pas dan zijn we geïnteresseerd in de feitelijke foutmarge.

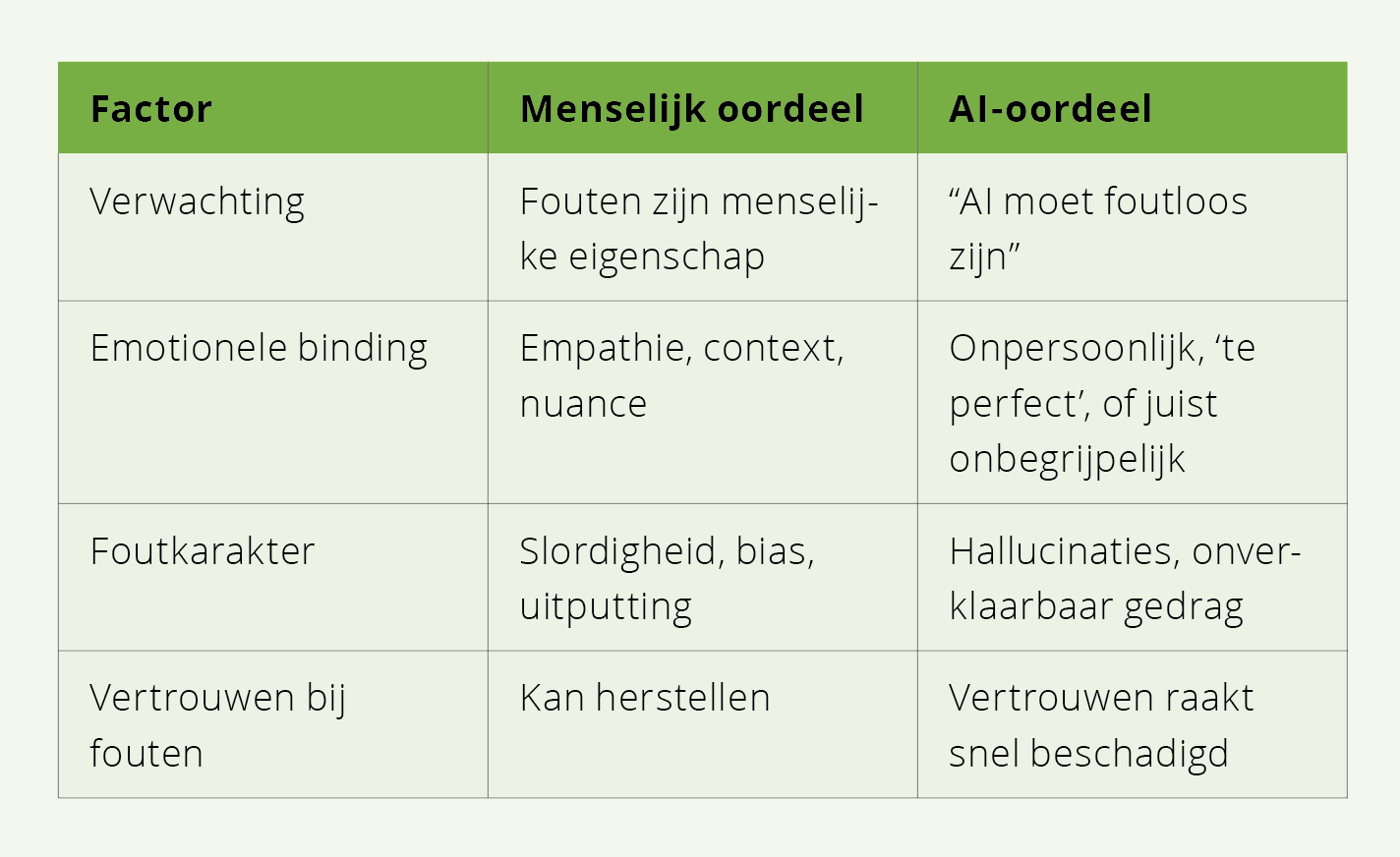

We beoordelen AI-toepassingen en helemaal LLM’s (Large Language Models) vooral vanuit gevoel. We zijn minder vergevingsgezind bij een hallucinatie dan een verkeerde uitleg van een arts. Een belangrijke reden hiervoor kan gevonden worden in de constatering dat AI-fouten vaak van een andere aard zijn dan menselijke fouten - vaak geen slordigheid, maar hallucinaties of onverklaarbare uitschieters.

Die onvoorspelbaarheid in fouten door AI maakt ons meer ongerust dan bij menselijke fouten1. Ook omdat we niet goed weten wat we er mee moeten. En we de volgende keer dus ook met minder vertrouwen de uitkomsten weer tegemoet zien (pas op! LLM’s hallucineren!). Hoe zouden we de spreekkamer in lopen als op elke straathoek een poster hing met Pas op! Uw dokter maakt fouten! En natuurlijk heeft dat te maken met de torenhoge verwachtingen die we hadden bij AI en LLM’s: verwachtingen die gelukkig al wat realistischer worden.

Tegelijkertijd is er natuurlijk ook veel reden voor optimisme over het vertrouwen in AI-toepassingen. Wanneer AI medische dossiers samenvat, blijkt de kwaliteit van die samenvattingen minstens zo goed als die van artsen. In een studie van Schoonbeek et al. (2024) gaven artsen en patiënten zelfs méér vertrouwen aan de AI-versies (81%) dan aan die van mensen (77%).

En bewijst AI zich ook al in patiëntcommunicatie en in preventieve toepassingen. Een beetje ‘AIptimisme’ is dus wel gerechtvaardigd – mits we de moed hebben om van die gekke fouten te leren in plaats van ze af te straffen met wantrouwen.

Vertrouwen is daarmee geen bijzaak, maar de verborgen valuta van AI in de zorg. Zonder vertrouwen geen acceptatie, zonder acceptatie geen vooruitgang. Dat betekent een beetje meer vergevingsgezindheid; het betekent de uiteindelijke foutmarges en impact op gezondheidsuitkomsten wat meer met de menselijke maat meten dan alleen gevoel. En misschien is dat wel de belangrijkste constatering: niet transparantie, niet de toepassing, maar ons vertrouwen bepaalt of de pAIn uiteindelijk gAIn wordt.